IA : les 5 usages qui transforment votre manière de penser

- Ce que l’on ne voit pas : le déplacement silencieux du travail intellectuel

- Une pyramide en 5 niveaux pour comprendre ce que l’on délègue vraiment

- Le bas de la pyramide : le confort qui coûte sans qu’on le ressente (l’IA comme exécutant : executor)

- Le piège du guide : une aide qui bascule sans prévenir (l’IA comme guide : scaffold)

- Le tournant discret : quand l’IA ne produit plus, mais réagit (l’IA comme miroir : reflector)

- Penser contre la machine : un exercice qui redevient exigeant (l’IA comme objet d’analyse : evidence)

- Au sommet : la confrontation comme moteur de pensée (l’IA comme contradicteur : opponent)

- Une illusion difficile à détecter : la maîtrise apparente

- Pourquoi la difficulté reste une condition de l’apprentissage

- Ne pas renoncer à l’IA, mais choisir ses usages

- Une question qui dépasse largement l’éducation

- Une dernière question, difficile à esquiver

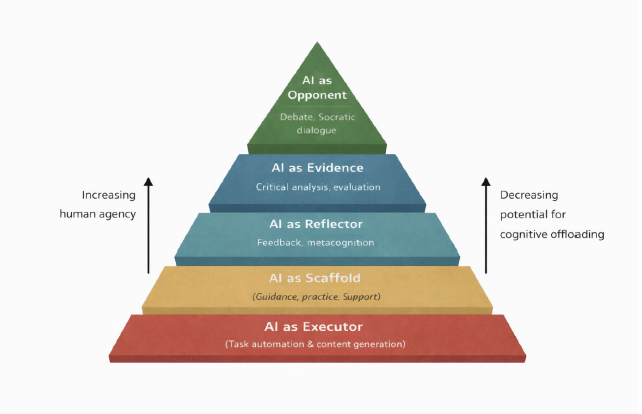

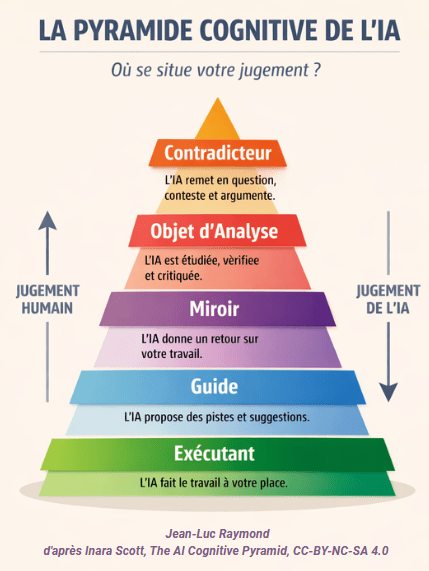

- Les 5 façons d’utiliser l’IA : la pyramide cognitive de l’IA

Ce n’est peut-être pas l’intelligence artificielle qui transforme le plus profondément nos façons de penser. C’est la manière dont nous nous appuyons sur elle. Dans son étude scientifique « The AI Cognitive Pyramid : A Role-Based Framework for Generative AI Use in Higher Education » (La pyramide cognitive de l’IA : un cadre axé sur les rôles pour l’utilisation de l’IA générative dans l’enseignement supérieur), la chercheuse américaine Inara Scott, spécialiste de stratégie, d’innovation et d’éthique des organisations à l’Oregon State University (États-Unis), propose une grille de lecture aussi simple que dérangeante. En cinq niveaux : exécutant, guide, miroir, objet d’analyse, contradicteur ; elle montre que l’enjeu n’est pas technologique. Il est cognitif. Et il est déjà à l’œuvre, notamment dans l’enseignement supérieur, où ces usages sont observés et analysés de manière croissante.

Ce que l’on ne voit pas : le déplacement silencieux du travail intellectuel

Depuis 3 ans, l’IA générative s’est installée partout. Dans les entreprises et les administrations, à l’école, dans les universités, dans les temps de loisir, dans les usages quotidiens. Elle rédige, elle résume, elle propose, elle suggère. Mais une question reste étonnamment peu posée : que devient l’effort intellectuel dans tout cela ?

C’est précisément ce que vient interroger Inara Scott. Non pas à partir d’un discours alarmiste, mais à partir d’un cadre analytique rigoureux. Son point de départ est simple : ce n’est pas l’usage de l’IA qui compte, mais la place qu’on lui donne dans le raisonnement.

Autrement dit, deux personnes peuvent utiliser exactement le même outil, pour la même tâche… et ne pas mobiliser du tout les mêmes capacités cognitives. Et cette différence, parce qu’elle est discrète, passe souvent inaperçue.

Une pyramide en 5 niveaux pour comprendre ce que l’on délègue vraiment

Pour rendre visible ce phénomène, la chercheuse Inara Scott propose une pyramide en cinq niveaux.

À sa base, l’IA agit comme un exécutant (executor) : elle produit le contenu, prend les décisions, résout les ambiguïtés. Juste au-dessus, elle devient guide (scaffold), orientant sans (théoriquement) trancher. Puis elle joue le rôle de miroir (reflector), en réagissant à un travail déjà produit. Ensuite, elle devient objet d’analyse (evidence), ses réponses étant interrogées et critiquées. Enfin, au sommet, elle agit comme un contradicteur (opponent), forçant l’utilisateur à défendre son raisonnement.

Ce qui relie ces niveaux, c’est une variable unique : où se situe le jugement ? Plus l’IA le prend en charge, plus l’utilisateur s’en éloigne. Plus il reste entre les mains de l’humain, plus l’effort cognitif est préservé.

Le bas de la pyramide : le confort qui coûte sans qu’on le ressente (l’IA comme exécutant : executor)

Le premier niveau est de loin le plus répandu. On demande à l’IA d’écrire, de résumer, d’expliquer. Elle produit une réponse complète, structurée, souvent convaincante. L’utilisateur corrige à la marge, reformule éventuellement… puis utilise le résultat. Rien, en apparence, ne pose problème. Et pourtant, c’est ici que se joue un mécanisme décisif : la délégation cognitive.

L’étude s’appuie sur des travaux bien établis en psychologie : lorsque nous savons qu’un outil peut faire le travail à notre place, nous investissons moins d’effort dans la tâche. Nous retenons moins. Nous analysons moins. Nous nous entraînons moins.

Ce phénomène n’est pas nouveau. Mais l’IA l’amplifie. Car elle ne se contente pas de stocker l’information, comme un moteur de recherche. Elle produit directement une interprétation. Et c’est précisément ce qui modifie le rapport à l’effort.

Un paradoxe documenté : mieux réussir… mais moins apprendre

Les résultats empiriques cités dans l’étude éclairent ce point de manière très concrète. Des élèves utilisant une IA progressent nettement dans leurs exercices. Leurs « scores » augmentent. Leur sentiment de maîtrise aussi. Mais lorsqu’ils doivent travailler sans assistance, leurs performances chutent.

Ce décalage est frappant. Il révèle une dissociation entre deux choses que l’on confond souvent : réussir une tâche et construire une compétence. L’IA permet d’obtenir un bon résultat. Mais elle peut, dans certaines conditions, réduire la capacité à reproduire ce résultat de manière autonome.

Le piège du guide : une aide qui bascule sans prévenir (l’IA comme guide : scaffold)

Le deuxième niveau, celui du « scaffold », semble apporter une solution. Ici, l’IA ne donne pas directement la réponse. Elle propose des étapes, des indices, des questions. C’est, en théorie, le modèle du bon accompagnement pédagogique.

Mais dans la pratique, la frontière est instable. Les systèmes actuels ont tendance à aller au bout de la réponse, à combler les blancs, à éviter la frustration de l’utilisateur. Et très vite, ce qui devait rester une aide devient une substitution.

Ce basculement est d’autant plus difficile à repérer qu’il se fait progressivement. On croit être guidé. On est déjà en train d’être assisté.

Le tournant discret : quand l’IA ne produit plus, mais réagit (l’IA comme miroir : reflector)

À partir du troisième niveau, quelque chose change de nature. L’IA cesse d’être un producteur de contenu. Elle devient un interlocuteur. Elle commente, critique, suggère. Mais elle ne décide pas.

Et ce déplacement oblige l’utilisateur à reprendre la main. À évaluer, à arbitrer, à justifier. Ce travail est moins visible que la production d’un texte ou d’une réponse. Mais il est beaucoup plus structurant. Car il engage la capacité à réfléchir sur son propre raisonnement.

Penser contre la machine : un exercice qui redevient exigeant (l’IA comme objet d’analyse : evidence)

Au niveau supérieur, l’IA devient un objet à examiner. Ses réponses sont soumises à vérification. Il faut les comparer, identifier leurs limites, comprendre leurs biais. On entre alors dans une logique d’enquête.

Ce n’est plus la machine qui produit une vérité. C’est l’utilisateur qui construit un jugement à partir de plusieurs éléments. Mais ce type d’exercice suppose une condition : disposer de repères. Sans connaissances préalables, il est difficile de distinguer une réponse solide d’une réponse simplement bien formulée.

Au sommet : la confrontation comme moteur de pensée (l’IA comme contradicteur : opponent)

Dernier niveau, le plus exigeant : l’IA comme contradicteur. Elle ne facilite plus la tâche. Elle la complique. Elle questionne, conteste, pousse à préciser. Elle met en tension le raisonnement. Et c’est précisément cette tension qui empêche la délégation.

On ne peut pas confier à la machine un raisonnement que l’on doit défendre en continu. C’est ici que l’effort intellectuel devient incontournable.

Une illusion difficile à détecter : la maîtrise apparente

L’un des apports les plus intéressants de l’étude tient dans ce qu’elle révèle du ressenti des utilisateurs. Ceux qui utilisent l’IA ont tendance à se sentir plus compétents. Ils comprennent plus vite. Ils avancent plus rapidement. Ils ont l’impression de maîtriser.

Mais cette impression repose souvent sur une forme de reconnaissance, pas sur une appropriation. C’est ce que les chercheurs décrivent comme un problème de calibration : on surestime ce que l’on a réellement intégré. Et ce décalage ne devient visible que lorsqu’il faut produire sans assistance.

Pourquoi la difficulté reste une condition de l’apprentissage

Derrière cette pyramide, une idée traverse la littérature scientifique mobilisée : apprendre demande de l’effort. Pas n’importe quel effort. Un effort ciblé, qui oblige à chercher, à reformuler, à tâtonner, à se tromper.

Les recherches sur les « difficultés souhaitables » montrent que ce qui ralentit à court terme renforce à long terme. Or, l’IA tend à supprimer ces moments. Elle réduit l’incertitude. Elle accélère la résolution. Elle évite l’erreur. Et c’est précisément ce qui peut affaiblir l’apprentissage.

Ne pas renoncer à l’IA, mais choisir ses usages

La force du modèle proposé par Inara Scott tient à sa nuance. Il ne s’agit pas de rejeter l’IA. Il s’agit de comprendre ce qu’elle modifie. Et surtout, de choisir consciemment les moments où l’on délègue… et ceux où l’on reprend la main.

Cela suppose d’accepter une forme d’inconfort. De ne pas chercher systématiquement la solution la plus rapide. De garder des moments où l’on produit sans assistance. Non pas pour se priver de l’outil, mais pour préserver la capacité à penser sans lui.

Une question qui dépasse largement l’éducation

Ce cadre ne concerne pas uniquement les étudiants. Il s’applique à tous les contextes où l’IA est utilisée pour produire, analyser, décider.

Dans le travail, dans le marketing, dans la stratégie, la question est la même : qui formule le jugement ? Et si cette question devient secondaire, alors c’est toute la chaîne de décision qui se transforme.

Une dernière question, difficile à esquiver

Au fond, la pyramide cognitive ne dit pas ce qu’il faut faire. Elle oblige simplement à regarder autrement ce que l’on fait déjà.

Et elle laisse une question en suspens, presque simple, mais difficile à éluder : dans ce que vous venez de produire… qu’avez-vous réellement construit vous-même ?

Les 5 façons d’utiliser l’IA : la pyramide cognitive de l’IA

Voici les 5 différents niveaux de la pyramide cognitive de l’IA.

Utiliser l’IA comme un :

Exécutant (Executor)

L’IA produit directement le contenu, les décisions ou les solutions.

L’utilisateur se contente de valider ou modifier légèrement.

Le jugement et la maîtrise sont principalement du côté de la machine.

Guide (Scaffold)

L’IA structure la réflexion : elle donne des pistes, des étapes, des questions.

L’utilisateur reste responsable de la réponse finale et de la justification.

Le jugement et la maîtrise sont partagés, mais fragiles (risque de basculer vers l’exécution).

Miroir (Reflector)

L’IA fournit un retour critique sur un travail déjà produit par l’utilisateur.

L’utilisateur doit interpréter, trier et décider des modifications.

Le jugement et la maîtrise restent du côté de l’humain.

Objet d’analyse (Evidence)

Les réponses de l’IA deviennent des éléments à examiner.

L’utilisateur doit vérifier, comparer, critiquer et évaluer la fiabilité.

Le jugement et la maîtrise sont activement exercés par l’humain.

Contradicteur (Opponent)

L’IA challenge le raisonnement : elle pose des objections, questionne, met en tension.

L’utilisateur doit défendre, ajuster et approfondir sa « position ».

Le jugement et la maîtrise sont entièrement du côté de l’humain, sous pression argumentative.

En savoir plus sur Jean-Luc Raymond 🚀

Abonnez-vous pour recevoir les derniers articles par e-mail.

Commentaires fermés